Ultralytics 基于多年在计算机视觉和人工智能领域的基础研究,创造了尖端的、最先进的 (SOTA) YOLO 模型。我们的模型不断更新以提高性能和灵活性,具有速度快、精度高和易于使用的特点。它们在目标检测、跟踪、实例分割、图像分类和姿态估计任务中表现出色。

在 Ultralytics 文档中查找详细文档。通过 GitHub Issues 获取支持。加入 Discord、Reddit 和 Ultralytics 社区论坛参与讨论!

如需商业用途,请在 Ultralytics 授权许可申请企业许可证。

请参阅下文了解快速安装和使用示例。有关训练、验证、预测和部署的全面指南,请参阅我们的完整 Ultralytics 文档。

安装

在 Python>=3.8 环境中安装 ultralytics 包,包括所有依赖项,并确保 PyTorch>=1.8。

pip install ultralytics

使用方法

您可以直接通过命令行界面 (CLI) 使用 yolo 命令来运行 Ultralytics YOLO:

# 使用预训练的 YOLO 模型 (例如 YOLO26n) 对图像进行预测

yolo predict model=yolo26n.pt source='https://ultralytics.com/images/bus.jpg'

yolo 命令支持各种任务和模式,并接受额外的参数,如 imgsz=640。浏览 YOLO CLI 文档获取更多示例。

Ultralytics YOLO 也可以直接集成到您的 Python 项目中。它接受与 CLI 相同的配置参数:

from ultralytics import YOLO

# 加载一个预训练的 YOLO26n 模型

model = YOLO("yolo26n.pt")

# 在 COCO8 数据集上训练模型 100 个周期

train_results = model.train(

data="coco8.yaml", # 数据集配置文件路径

epochs=100, # 训练周期数

imgsz=640, # 训练图像尺寸

device="cpu", # 运行设备 (例如 'cpu', 0, [0,1,2,3])

)

# 评估模型在验证集上的性能

metrics = model.val()

# 对图像执行目标检测

results = model("path/to/image.jpg") # 对图像进行预测

results[0].show() # 显示结果

# 将模型导出为 ONNX 格式以进行部署

path = model.export(format="onnx") # 返回导出模型的路径

在 YOLO Python 文档中发现更多示例。

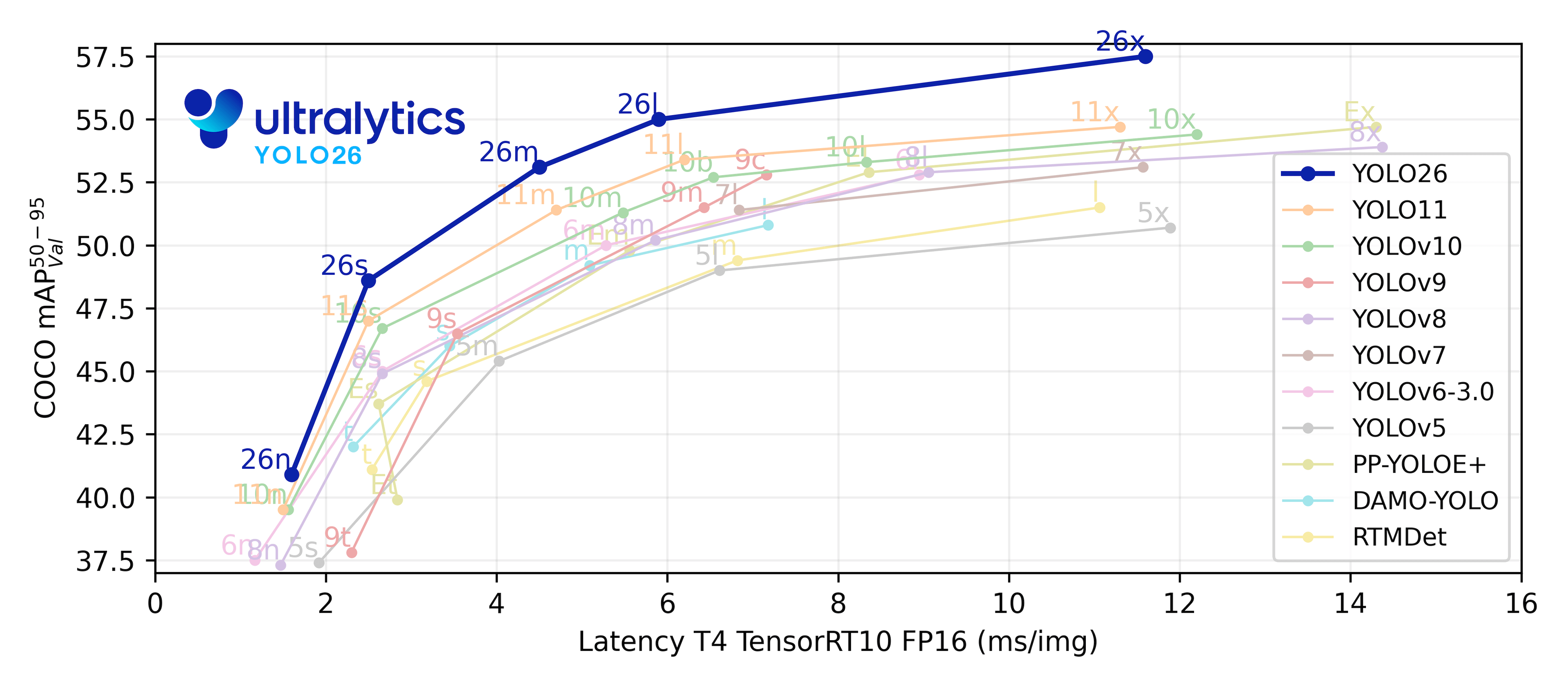

Ultralytics 支持广泛的 YOLO 模型,从早期的版本如 YOLOv3 到最新的 YOLO26。下表展示了在 COCO 数据集上预训练的 YOLO26 模型,用于检测、分割和姿态估计任务。此外,还提供了在 ImageNet 数据集上预训练的分类模型。跟踪模式与所有检测、分割和姿态模型兼容。所有模型在首次使用时都会自动从最新的 Ultralytics 发布版本下载。

检测 (COCO)

浏览检测文档获取使用示例。这些模型在 COCO 数据集上训练,包含 80 个对象类别。

| 模型 | 尺寸 (像素) | mAPval 50-95 | 速度 CPU ONNX (毫秒) | 速度 T4 TensorRT10 (毫秒) | 参数 (百万) | FLOPs (十亿) |

|---|---|---|---|---|---|---|

| YOLO26n | 640 | 40.9 | 38.9 ± 0.7 | 1.7 ± 0.0 | 2.4 | 5.4 |

| YOLO26s | 640 | 48.6 | 87.2 ± 0.9 | 2.5 ± 0.0 | 9.5 | 20.7 |

| YOLO26m | 640 | 53.1 | 220.0 ± 1.4 | 4.7 ± 0.1 | 20.4 | 68.2 |

| YOLO26l | 640 | 55.0 | 286.2 ± 2.0 | 6.2 ± 0.2 | 24.8 | 86.4 |

| YOLO26x | 640 | 57.5 | 525.8 ± 4.0 | 11.8 ± 0.2 | 55.7 | 193.9 |

- mAPval 值指的是在 COCO val2017 数据集上的单模型单尺度性能。详见 YOLO 性能指标。

使用yolo val detect data=coco.yaml device=0复现结果。 - 速度 指标是在 Amazon EC2 P4d 实例上对 COCO val 图像进行平均测量的。CPU 速度使用 ONNX 导出进行测量。GPU 速度使用 TensorRT 导出进行测量。

使用yolo val detect data=coco.yaml batch=1 device=0|cpu复现结果。

分割 (COCO)

请参阅分割文档获取使用示例。这些模型在 COCO-Seg 数据集上训练,包含 80 个类别。

| 模型 | 尺寸 (像素) | mAPbox 50-95 | mAPmask 50-95 | 速度 CPU ONNX (毫秒) | 速度 T4 TensorRT10 (毫秒) | 参数 (百万) | FLOPs (十亿) |

|---|---|---|---|---|---|---|---|

| YOLO26n-seg | 640 | 39.6 | 33.9 | 53.3 ± 0.5 | 2.1 ± 0.0 | 2.7 | 9.1 |

| YOLO26s-seg | 640 | 47.3 | 40.0 | 118.4 ± 0.9 | 3.3 ± 0.0 | 10.4 | 34.2 |

| YOLO26m-seg | 640 | 52.5 | 44.1 | 328.2 ± 2.4 | 6.7 ± 0.1 | 23.6 | 121.5 |

| YOLO26l-seg | 640 | 54.4 | 45.5 | 387.0 ± 3.7 | 8.0 ± 0.1 | 28.0 | 139.8 |

| YOLO26x-seg | 640 | 56.5 | 47.0 | 787.0 ± 6.8 | 16.4 ± 0.1 | 62.8 | 313.5 |

- mAPval 值指的是在 COCO val2017 数据集上的单模型单尺度性能。详见 YOLO 性能指标。

使用yolo val segment data=coco.yaml device=0复现结果。 - 速度 指标是在 Amazon EC2 P4d 实例上对 COCO val 图像进行平均测量的。CPU 速度使用 ONNX 导出进行测量。GPU 速度使用 TensorRT 导出进行测量。

使用yolo val segment data=coco.yaml batch=1 device=0|cpu复现结果。

分类 (ImageNet)

请查阅分类文档获取使用示例。这些模型在 ImageNet 数据集上训练,涵盖 1000 个类别。

| 模型 | 尺寸 (像素) | acc top1 | acc top5 | 速度 CPU ONNX (毫秒) | 速度 T4 TensorRT10 (毫秒) | 参数 (百万) | FLOPs (十亿) @ 224 |

|---|---|---|---|---|---|---|---|

| YOLO26n-cls | 224 | 71.4 | 90.1 | 5.0 ± 0.3 | 1.1 ± 0.0 | 2.8 | 0.5 |

| YOLO26s-cls | 224 | 76.0 | 92.9 | 7.9 ± 0.2 | 1.3 ± 0.0 | 6.7 | 1.6 |

| YOLO26m-cls | 224 | 78.1 | 94.2 | 17.2 ± 0.4 | 2.0 ± 0.0 | 11.6 | 4.9 |

| YOLO26l-cls | 224 | 79.0 | 94.6 | 23.2 ± 0.3 | 2.8 ± 0.0 | 14.1 | 6.2 |

| YOLO26x-cls | 224 | 79.9 | 95.0 | 41.4 ± 0.9 | 3.8 ± 0.0 | 29.6 | 13.6 |

- acc 值表示模型在 ImageNet 数据集验证集上的准确率。

使用yolo val classify data=path/to/ImageNet device=0复现结果。 - 速度 指标是在 Amazon EC2 P4d 实例上对 ImageNet val 图像进行平均测量的。CPU 速度使用 ONNX 导出进行测量。GPU 速度使用 TensorRT 导出进行测量。

使用yolo val classify data=path/to/ImageNet batch=1 device=0|cpu复现结果。

姿态估计 (COCO)

请参阅姿态估计文档获取使用示例。这些模型在 COCO-Pose 数据集上训练,专注于 'person' 类别。

| 模型 | 尺寸 (像素) | mAPpose 50-95 | mAPpose 50 | 速度 CPU ONNX (毫秒) | 速度 T4 TensorRT10 (毫秒) | 参数 (百万) | FLOPs (十亿) |

|---|---|---|---|---|---|---|---|

| YOLO26n-pose | 640 | 57.2 | 83.3 | 40.3 ± 0.5 | 1.8 ± 0.0 | 2.9 | 7.5 |

| YOLO26s-pose | 640 | 63.0 | 86.6 | 85.3 ± 0.9 | 2.7 ± 0.0 | 10.4 | 23.9 |

| YOLO26m-pose | 640 | 68.8 | 89.6 | 218.0 ± 1.5 | 5.0 ± 0.1 | 21.5 | 73.1 |

| YOLO26l-pose | 640 | 70.4 | 90.5 | 275.4 ± 2.4 | 6.5 ± 0.1 | 25.9 | 91.3 |

| YOLO26x-pose | 640 | 71.7 | 91.6 | 565.4 ± 3.0 | 12.2 ± 0.2 | 57.6 | 201.7 |

- mAPval 值指的是在 COCO Keypoints val2017 数据集上的单模型单尺度性能。详见 YOLO 性能指标。

使用yolo val pose data=coco-pose.yaml device=0复现结果。 - 速度 指标是在 Amazon EC2 P4d 实例上对 COCO val 图像进行平均测量的。CPU 速度使用 ONNX 导出进行测量。GPU 速度使用 TensorRT 导出进行测量。

使用yolo val pose data=coco-pose.yaml batch=1 device=0|cpu复现结果。

定向边界框 (DOTAv1)

请查阅 OBB 文档获取使用示例。这些模型在 DOTAv1 数据集上训练,包含 15 个类别。

| 模型 | 尺寸 (像素) | mAPtest 50 | 速度 CPU ONNX (毫秒) | 速度 T4 TensorRT10 (毫秒) | 参数 (百万) | FLOPs (十亿) |

|---|---|---|---|---|---|---|

| YOLO26n-obb | 1024 | 78.9 | 97.7 ± 0.9 | 2.8 ± 0.0 | 2.5 | 14.0 |

| YOLO26s-obb | 1024 | 80.9 | 218.0 ± 1.4 | 4.9 ± 0.1 | 9.8 | 55.1 |

| YOLO26m-obb | 1024 | 81.0 | 579.2 ± 3.8 | 10.2 ± 0.3 | 21.2 | 183.3 |

| YOLO26l-obb | 1024 | 81.6 | 735.6 ± 3.1 | 13.0 ± 0.2 | 25.6 | 230.0 |

| YOLO26x-obb | 1024 | 81.7 | 1485.7 ± 11.5 | 30.5 ± 0.9 | 57.6 | 516.5 |

- mAPtest 值指的是在 DOTAv1 测试集上的单模型多尺度性能。

通过yolo val obb data=DOTAv1.yaml device=0 split=test复现结果,并将合并后的结果提交到 DOTA 评估服务器。 - 速度 指标是在 Amazon EC2 P4d 实例上对 DOTAv1 val 图像进行平均测量的。CPU 速度使用 ONNX 导出进行测量。GPU 速度使用 TensorRT 导出进行测量。

通过yolo val obb data=DOTAv1.yaml batch=1 device=0|cpu复现结果。

我们与领先 AI 平台的关键集成扩展了 Ultralytics 产品的功能,增强了数据集标注、训练、可视化和模型管理等任务。了解 Ultralytics 如何与 Weights & Biases、Comet ML、Roboflow 和 Intel OpenVINO 等合作伙伴协作,优化您的 AI 工作流程。在 Ultralytics 集成了解更多信息。

| Ultralytics Platform 🌟 | Weights & Biases | Comet | Neural Magic |

|---|---|---|---|

| 简化 YOLO 工作流程:使用 Ultralytics 平台 轻松进行标注、训练和部署。立即试用! | 使用 Weights & Biases 跟踪实验、超参数和结果。 | 永久免费的 Comet ML 让您能够保存 YOLO 模型、恢复训练并交互式地可视化预测结果。 | 使用 Neural Magic DeepSparse,将 YOLO 推理速度提高多达 6 倍。 |

我们依靠社区协作蓬勃发展!没有像您这样的开发者的贡献,Ultralytics YOLO 就不会成为如今最先进的框架。请参阅我们的贡献指南开始贡献。我们也欢迎您的反馈——通过完成我们的调查问卷分享您的体验。非常感谢 🙏 每一位贡献者!

我们期待您的贡献,帮助 Ultralytics 生态系统变得更好!

Ultralytics 提供两种许可选项以满足不同需求:

- AGPL-3.0 许可证:这种经 OSI 批准的开源许可证非常适合学生、研究人员和爱好者。它鼓励开放协作和知识共享。有关完整详细信息,请参阅 LICENSE 文件。

- Ultralytics 企业许可证:专为商业用途设计,此许可证允许将 Ultralytics 软件和 AI 模型无缝集成到商业产品和服务中,绕过 AGPL-3.0 的开源要求。如果您的使用场景涉及商业部署,请通过 Ultralytics 授权许可与我们联系。

有关 Ultralytics 软件的错误报告和功能请求,请访问 GitHub Issues。如有疑问、讨论和社区支持,请加入我们在 Discord、Reddit 和 Ultralytics 社区论坛上的活跃社区。我们随时为您提供有关 Ultralytics 的所有帮助!